Cours n°3 – Histoire de la physique de la lumière, deuxième partie

En Angleterre, dès 1801, et alors que la communauté scientifique soutient presque unanimement l’interprétation corpusculaire, Thomas Young décrit le phénomène d’interférence qui ne peut être expliqué que par une théorie ondulatoire de la lumière. Young est le premier à concevoir la lumière comme une ondulation périodique oscillant à la fois dans l’espace (longueur d’onde λ) et dans le temps (période T), tout en se propageant à la vitesse c telle que λ=cT. Il comprend alors que les couleurs de l’arc-en-ciel correspondent aux différentes longueurs d’onde de la lumière visible, la longueur d’onde de la lumière rouge étant plus grande que la longueur d’onde de la lumière violette.

Son principe d’interférence repose sur l’idée qu’une onde est une succession de crêtes et de creux, pouvant être représentée par une fonction sinusoïdale prenant des valeurs alternativement négatives et positives. Lorsqu’on superpose deux ondes de même longueur d’onde, l’interférence peut être constructive (si les crêtes et les creux des deux ondes coïncident, et donc se renforcent) et l’onde résultante est alors intense. Mais elle peut également être destructive (si les creux d’une onde sont compensés par les crêtes de l’autre), au point de pouvoir annuler l’amplitude de l’onde résultante. Ainsi, pour Young, l’obscurité peut être engendrée en ajoutant de la lumière à la lumière, ce qui est totalement incompatible avec une interprétation corpusculaire.

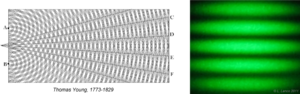

La célèbre expérience des trous d’Young consiste à éclairer deux petits trous et à regarder la figure d’interférence sur un écran placé plus loin: du fait de l’addition des ondes associées à chaque trou, on observe des franges sombres périodiquement alternées avec des franges lumineuses. Dans les endroits sombres, il y a interférence destructive : les maxima de la première onde coïncident avec les minima de la seconde, ce qui conduit à une onde résultante nulle. Dans les endroits lumineux il y a interférence constructive, conduisant à une onde résultante intense. La figure ci-dessous reproduit le schéma original de Thomas Young et montre une photographie des franges obtenues avec un laser Helium-Neon de couleur rouge.

A l’aide du principe d’interférence, Young est également le premier à expliquer le phénomène des « anneaux de Newton » (voir cours précédent) en considérant la superposition de deux ondes : celle réfléchie sur la première interface et celle réfléchie sur la seconde. Comme dans le cas précédent, les anneaux sombres résultent d’une interférence destructive et les anneaux lumineux d’une interférence constructive. Young parvient à déduire de ses diverses expériences une mesure de la longueur d’onde de la lumière visible.

De l’autre coté de la Manche, c’est en 1819 qu’Augustin-Jean Fresnel apporte une contribution majeure à la théorie ondulatoire, avec une analyse très précise et complète du phénomène de diffraction à travers un trou. Fresnel considère l’interférence de toutes les ondes émises par chaque point du trou, en comparant leurs temps de trajet pour déterminer si cette interférence est constructive ou destructive (voir figure ci-dessous). Pour la lumière incidente sur l’écran juste en face du trou, les ondes provenant des divers points du trou ont des temps de trajet proches, et l’interférence de toutes ces ondes est constructive. Pour un point de l’écran situé à l’écart, par contre, les ondes émises par chaque point du trou ont des temps de trajet différents et l’interférence est donc destructive: c’est ce qui explique que la lumière ne semble se propager qu’en ligne droite. Mais Fresnel comprend que le caractère constructif ou destructif de l’interférence dépend de la taille du trou. Pour un trou de petite taille il est possible d’avoir une luminosité non négligeable même pour de la lumière émise en biais: c’est le phénomène de diffraction.

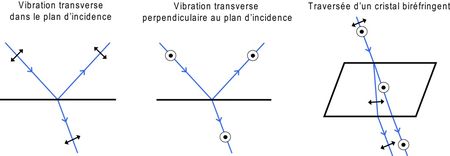

En 1821, Fresnel enfonce le clou en expliquant la polarisation de la lumière par le fait que les ondes lumineuses sont des ondes transverses (ondes pour lesquelles la vibration se fait dans le plan perpendiculaire à la direction de propagation). Il parvient à prédire les coefficients de réflexion et de transmission de la lumière à une interface, pour les ondes transverses vibrant dans le plan d’incidence comme pour celles vibrant perpendiculairement au plan d’incidence. Il explique également le phénomène de biréfringence de façon plus rigoureuse que ce qu’avait fait Huygens, en accord avec l’ensemble des résultats expérimentaux.

La théorie ondulatoire se heurte toutefois au problème de l'identification du support de la vibration. La lumière se propageant dans le vide, de quoi peut-elle être la vibration? En mécanique, les ondes transverses n'existent que dans des milieux visqueux ou rigides (vagues à la surface de l’eau, ondes sismiques...). Ceci explique la difficulté, au 19ème siècle, d'assimiler la lumière à une onde transverse : comment le vide spatial peut-il être visqueux ou rigide? Quelle est la nature de l'éther et comment sert-il de support à l’onde lumineuse?

Un premier élément de réponse est fourni par le calcul de Weber et Kohlrausch en 1857, qui montrent que le produit de la constante de l’électricité ε0 et de la constante du magnétisme μ0 donne l’inverse d’une vitesse au carré... et que cette vitesse correspond à la vitesse de la lumière. James Clerk Maxwell, en s’inspirant de cette « coïncidence », pose en 1873 des équations de l’électricité et du magnétisme qui permettent de décrire des ondes électromagnétiques se propageant à la vitesse c. Il n'y a finalement pas besoin de connaître la nature de l’éther : le champ électromagnétique est simplement une grandeur vectorielle, qui a une valeur en chaque point de l'espace et à chaque instant. Le champ électrique E et le champ magnétique B permettent d'exprimer la force ressentie par une particule chargée : F=qE+qv^B.

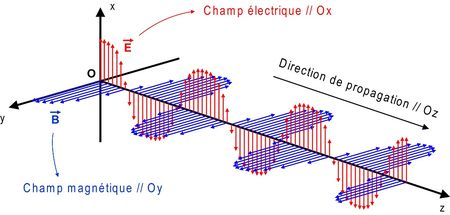

La lumière est alors assimilée à une onde électromagnétique transverse, la polarisation de la lumière étant simplement la direction du champ électrique oscillant (dans l’exemple ci-dessous, une onde polarisée suivant l’axe Ox). Tous les phénomènes électromagnétiques, qui couvrent des domaines très variés comme les rayons X, les micro-ondes, la lumière, ou les ondes radio, obéissent tous aux mêmes équations de Maxwell. Cependant, même si les équations sont les mêmes, les propriétés des matériaux diffèrent énormément d'une bande spectrale à une autre. Par exemple, un mur est transparent aux ondes hertziennes mais pas au visible, une vitre est transparente au visible mais pas à l'infrarouge, etc...

L'ensemble des ondes électromagnétiques peut être représenté en fonction de la longueur d'onde ou de la fréquence. On parle alors du spectre électromagnétique, qui s'étend sur un nombre considérable d'ordres de grandeurs, depuis les ondes radiofréquences (longueurs d'ondes pouvant dépasser plusieurs dizaines de kilomètres), jusqu'aux ondes Gamma (longueurs d’ondes inférieures au picomètre), émises en particulier par les étoiles ou au coeur des centrales nucléaires. Les équations de Maxwell représentent donc une unification majeure englobant les phénomènes de l'électricité, du magnétisme, et de la lumière. La satisfaction de certains physiciens était telle que, en 1903, Michelson écrit: « Les lois et les faits les plus fondamentaux des sciences physiques ont tous été découverts, et sont maintenant si fermement établis que la possibilité qu’il soient supplantés un jour, à la suite de nouvelles découvertes, est excessivement lointaine. [...] Nos futures découvertes doivent être recherchées du coté de la sixième décimale ».

A cette même époque, alors que les phénomènes lumineux semblent tous pouvoir être interprétés en termes ondulatoires, Lord Kelvin considère toutefois que « la clarté et la beauté de la théorie [...] est à présent obscurcie par deux nuages ». Le premier est l’impossibilité de mettre en évidence l’éther expérimentalement, tandis que le second est l’impossibilité de comprendre la loi du rayonnement thermique des objets (que nous étudierons dans le cours n°6). Deux ans seulement après la déclaration naïve de Michelson, les nuages de Lord Kelvin vont justement donner lieu aux deux plus importantes révolutions de la physique du XXème siècle : la théorie de la relativité restreinte et la physique quantique. La première a conduit les physiciens à repenser l’espace-temps, et à abandonner au passage la notion d’éther. La seconde a bouleversé le siècle dernier par l'ampleur des phénomènes qu'elle a permis d'expliquer et les applications considérables qu'elle a suscitées.

Dans le cadre de la physique quantique, il apparaît que la description ondulatoire des phénomènes lumineux ne suffit pas toujours. L'échange d'énergie entre la lumière et la matière ne peut en effet se produire que sous forme de « quanta de lumière » dont l’énergie est bien déterminée. Ainsi, un rayonnement de fréquence ν peut être considéré comme composé de très nombreux quanta, appelés photons, ayant tous la même énergie E_photon=hν, ou h est une nouvelle constante fondamentale de la physique nommée constante de Planck. Le comportement de ces quanta d'énergie électromagnétique n’a rien à voir avec celui de corpuscules classiques, puisque ces photons sont délocalisés. La lumière n'est ainsi ni un phénomène strictement ondulatoire, ni un phénomène strictement corpusculaire. Le point de vue sous lequel le physicien a intérêt à la décrire dépend de l'expérience considérée, du contexte.

L’idée que la lumière est composée de quanta a été introduite pour la première fois par Einstein pour expliquer l’effet photoélectrique, dans l’un de ses trois articles révolutionnaires de l’année 1905 (les deux autres introduisaient la théorie de la relativité restreinte et l’égalité E=mc²). Heinrich Hertz avait caractérisé cet effet en 1887: lorsqu’on éclaire une plaque métallique avec de la lumière ultraviolette, des électrons sont éjectés du métal avec une énergie cinétique non négligeable. Si on éclaire le métal avec un rayonnement de plus faible fréquence (par exemple une lumière bleue), l’énergie cinétique des électrons éjectés est plus faible. Si l’on baisse encore la fréquence du rayonnement incident (par exemple une lumière rouge), plus aucun électron n’est éjecté. Einstein comprend que l’éjection d’un électron provient de l’absorption d’un quantum de lumière d’énergie hν, comme illustré sur la figure ci-dessous. Un électron n’est éjecté, suite à l’absorption d’un quantum de lumière, que si ce dernier lui apporte une énergie hν plus grande que l’énergie de liaison de l’électron dans le métal. L’éventuel excédent d’énergie est transformé en énergie cinétique de l’électron éjecté.

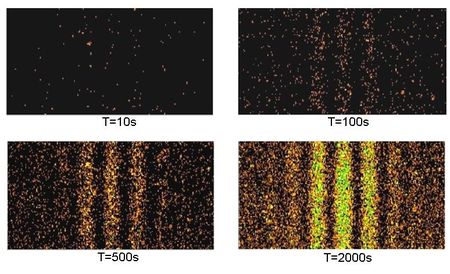

Les deux aspects corpusculaires et ondulatoires peuvent parfois être mis en évidence par une même expérience: par exemple, la photographie ci-dessous montre la figure d'interférence obtenue en faisant passer de la lumière dans deux trous d'Young, photon par photon (expérience réalisée au Laboratoire LPQM de l’ENS Cachan). Les photons sont détectés un par un, ce qui est caractéristique d’un comportement corpusculaire, mais la figure d’interférence finale est typique d’un comportement ondulatoire. Les photons (comme toutes les autres « particules », d’ailleurs) ne sont ni des ondes ni des corpuscules; ils obéissent à des règles très particulières, les lois de la physique quantique. Les applications que la physique quantique a permises au 20ème siècle sont considérables, avec par exemple les dispositifs clés de la révolution de l'information : le laser, le transistor et le disque dur. Le prix Nobel décerné à Albert Fert et Peter Grünberg en 2007 est l'hommage le plus récent à cette recherche sur les dispositifs quantiques.

Laboratoire de Photonique Quantique et Moléculaire, ENS-Cachan

Une version imprimable de ce résumé de cours peut être téléchargée en cliquant sur ce lien.

/https%3A%2F%2Fprofilepics.canalblog.com%2Fprofilepics%2F5%2F6%2F560568.jpg)

/https%3A%2F%2Fstorage.canalblog.com%2F32%2F07%2F652243%2F59260714_o.jpg)

/https%3A%2F%2Fstorage.canalblog.com%2F46%2F20%2F652243%2F58807456_o.jpg)

/https%3A%2F%2Fstorage.canalblog.com%2F14%2F40%2F652243%2F58409941_o.jpg)

/https%3A%2F%2Fstorage.canalblog.com%2F61%2F32%2F652243%2F58030563_o.jpg)